Navegando pela Governança e Garantia da IA: O caso da Certificação do Sistema de Gestão de IA ISO/IEC 42001

Este white paper descreve a necessidade e como sua organização pode desenvolver, governar e cumprir continuamente os requisitos internos e externos para avançar na implementação bem-sucedida de IA em processos, produtos e serviços.

A inteligência artificial (IA) está transformando o mundo e criando novas oportunidades e desafios para as empresas e para a sociedade em geral. Com a chegada da IA generativa, como o ChatGPT e o Copilot, as experiências e o uso inicial de IA nas organizações explodiram. Implementações bem-sucedidas mostram que a IA pode impulsionar a eficiência, qualidade, inovação e satisfação do cliente. No entanto, toda nova tecnologia traz seus riscos. A IA está repleta de potenciais desafios e incertezas que precisam ser gerenciados e mitigados para garantir um desenvolvimento, aplicação e uso seguros, confiáveis e éticos.

É aqui que o papel de um Sistema de Gestão de IA (AIMS), baseado no padrão ISO/IEC 42001, torna-se essencial para as organizações gerenciarem sua jornada de IA. Uma abordagem estruturada obriga a “pensar antes de agir” e a avaliar continuamente o desempenho e os resultados. Este padrão fundamental de gestão de IA, abordagem de gestão de riscos e certificação por terceiros já é reconhecido como um pilar central para guiar o desenvolvimento e entregar soluções de IA confiáveis.

A necessidade de uso seguro e responsável da IA

A necessidade de uma IA confiável é impulsionada pelo aumento da experimentação e adoção de suas diversas aplicações, pela crescente conscientização e expectativas dos stakeholders, e pelo cenário ético e regulatório em evolução. Consequentemente, os benefícios da IA não podem ser plenamente realizados pelas organizações, a menos que a lacuna de confiança entre os desenvolvedores e usuários de IA seja superada. A lacuna de confiança refere-se à potencial falta de confiança e transparência nos produtos e/ou serviços habilitados por IA da sua organização. Por exemplo, quando não está claro para os usuários como os sistemas de IA tomam decisões, isso gera incerteza e ceticismo em torno da segurança, considerações éticas, proteção da privacidade de dados e credibilidade geral. Em termos simples, nossa confiança em uma tecnologia está baseada em nossa capacidade de entender completamente seus usos e obter garantias de que é segura e confiável.

Superar essa lacuna de confiança é essencial para comercializar e escalar produtos e serviços de IA. Isso exige garantir a implementação segura, responsável, confiável e ética da IA. Além disso, essa garantia deve ser fornecida tanto aos stakeholders internos, como seus colaboradores e alta direção, quanto aos stakeholders externos, como clientes e acionistas.

Alcançar e demonstrar a confiabilidade de suas soluções requer uma abordagem sistemática que cubra todo o ciclo de vida da IA, desde a análise dos stakeholders, definições adequadas (como diretrizes éticas), priorização de casos de uso e identificação de riscos, até a implementação de controles relevantes. Ao focarmos na lacuna de confiança, necessidades e expectativas claras podem ser identificadas. Por exemplo, sua organização deve:

- Identificar e priorizar as áreas e aplicações onde a IA pode agregar valor e criar impacto, além de entender os benefícios e riscos.

- Estabelecer e manter uma cultura de confiança, transparência e responsabilidade dentro das organizações.

- Avaliar e medir o desempenho e a qualidade dos sistemas de IA, garantindo o alinhamento com os princípios de confiabilidade, legislação existente ou futura, e requisitos dos clientes.

- Organizar papéis e responsabilidades nas organizações, o que é especialmente crítico em um domínio tecnológico que continua a evoluir e se desenvolver.

- Adotar e implementar processos baseados em padrões de melhores práticas (ex: ISO/IEC 42001) para o desenvolvimento, implementação e governança de IA.

- Comunicar a confiabilidade dos sistemas de IA aos stakeholders, fornecendo evidências e garantias de conformidade com as melhores práticas, leis e regulamentações.

Embora não seja exaustiva, esta é uma visão geral das necessidades e expectativas principais. O padrão do Sistema de Gestão de Inteligência Artificial ISO/IEC 42001 foi desenvolvido para fornecer orientação e estrutura para navegar efetivamente por essas questões.

O papel da padronização na governança da IA

Toda nova tecnologia traz seus riscos. O cenário em constante mudança da IA, aliado ao enorme potencial de suas aplicações em diversos setores, intensifica ainda mais essa situação. Prever todos os resultados na fase de design é impossível, por exemplo.

É nesse contexto que os padrões de sistemas de gestão como o ISO/IEC 42001 se tornam especialmente importantes. Sempre que há necessidade de confiança pública, a padronização e a certificação desempenham um papel crucial. Juntamente com as considerações legais, regulatórias e éticas, a padronização oferece um meio de permitir escalabilidade, incorporar segurança e guiar as organizações nesse território desconhecido que a IA atualmente representa.

Os padrões estabelecem terminologia essencial, promovem normas lideradas pela indústria e capturam as melhores práticas para avaliação e aprimoramento. Ao trazer clareza e responsabilidade, os padrões voltados para a gestão da IA ajudarão significativamente na aceitação pela sociedade. Eles oferecem uma base para conformidade regulatória e adoção pela indústria, acelerando a capacidade de aproveitar o potencial global da IA de maneira segura, responsável e ética, garantindo a transparência, confiança e segurança necessárias entre usuários e outros stakeholders.

Papel dos Sistemas de Gestão de IA

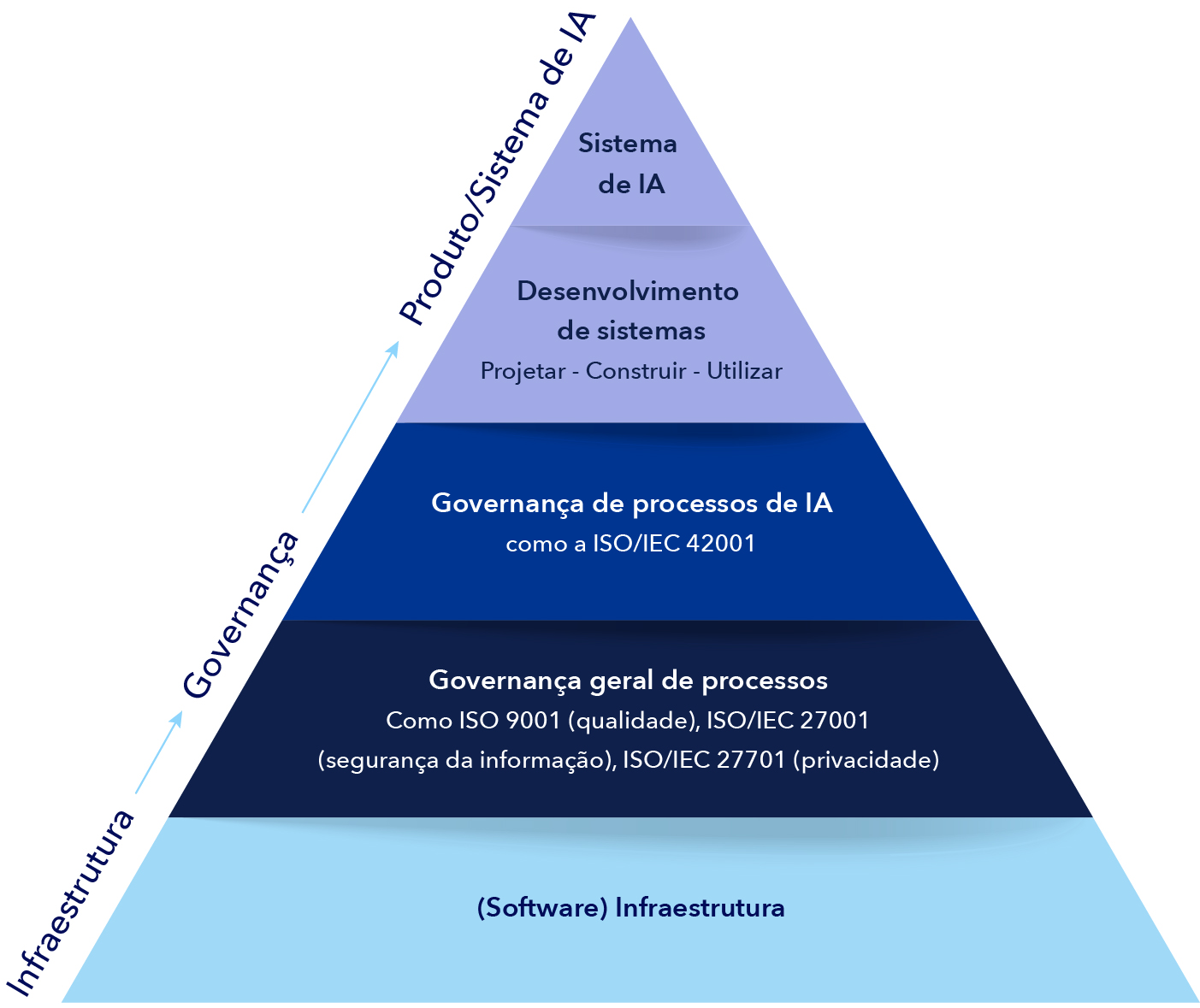

Os padrões de sistemas de gestão e a certificação podem atuar como uma base sólida para que as organizações montem sua governança em torno da IA (ver figura 1). O padrão internacional para sistemas de gestão de IA ISO/IEC 42001 oferece orientação e requisitos para organizações que desenvolvem, implementam ou utilizam sistemas de IA.

Este padrão, altamente aguardado, foi publicado no final de 2023 e é aplicável e destinado ao uso em diversos setores e por organizações de qualquer tipo e tamanho envolvidas no desenvolvimento, fornecimento ou uso de produtos e/ou serviços que utilizam sistemas de IA. Sendo um padrão ISO, ele é compatível e complementar a outros padrões clássicos de sistemas de gestão ISO, como o ISO 9001 (qualidade) e o ISO/IEC 27001 (segurança da informação). O ISO/IEC 42001 equilibra a promoção da inovação em IA com a implementação de uma governança eficaz.

Isso significa que você pode aproveitar e construir a partir de qualquer sistema de gestão existente e governança de processos em geral. Ele garante uma abordagem abrangente para governar como você integra a IA em produtos, serviços ou até mesmo em aplicações internas.

No esquema abaixo, posicionamos o ISO/IEC 42001 como uma ferramenta de governança de processos na 'pirâmide de garantia'. Na base da pirâmide, você encontrará a infraestrutura organizacional básica. Tudo o que precisa estar em vigor para que a organização funcione. Para governar e melhorar, muitas organizações optam por implementar sistemas de gestão em conformidade com padrões de qualidade (ISO 9001), segurança da informação (ISO/IEC 27001) ou qualquer outro padrão de sistema de gestão. A certificação, então, é o meio de demonstrar conformidade para vários stakeholders.

Como a ISO/IEC 42001 segue uma estrutura semelhante a outros padrões de sistemas de gestão ISO, ela facilita a complementação do seu sistema de gestão com os requisitos do sistema de gestão de IA. Dessa forma, sua governança de processos forma a base para projetar, construir e utilizar sistemas de IA confiáveis.

Os principais objetivos da ISO/IEC 42001 são:

- Fornecer um framework e metodologia para estabelecer, implementar, manter e melhorar um sistema de gestão de IA, cobrindo todo o ciclo de vida da IA, adotando uma abordagem baseada em riscos.

- Permitir a demonstração e comunicação da confiabilidade dos sistemas e processos de IA de uma organização.

- Ajudar na conformidade regulatória e legal, que se tornará cada vez mais crítica com o aumento das regulamentações nacionais e internacionais, como o Ato Europeu de IA, já em vigor desde agosto de 2024.

- Facilitar a interoperabilidade e integração de sistemas e processos de IA.

- Promover a colaboração e coordenação entre os stakeholders.

- Apoiar a inovação e a melhoria dos sistemas e processos de IA.

Incentivar a adoção e disseminação das melhores práticas e padrões de gestão de IA.

A relação entre a ISO/IEC 42001 e as leis e regulamentações de IA deve ser sinérgica e mutuamente benéfica. Embora o Ato Europeu de IA tenha um foco marcante em produtos, a adoção de um Sistema de Gestão de IA oferece uma base para construir e fornecer sistemas de IA confiáveis, consistentes e previsíveis, cujos controles do padrão estão alinhados com o que as regulamentações exigem para conformidade.

Em última análise, um sistema de gestão bem implementado e em conformidade com todos os padrões relevantes garantirá a integridade, a privacidade e o uso ético dos dados, sendo ao mesmo tempo adaptável o suficiente para integrar os requisitos sempre em evolução provenientes de clientes, avanços tecnológicos, instâncias legais e regulatórias, entre outros.

O caminho a seguir?

Para iniciar o processo de adoção de um sistema de gestão certificado pela ISO/IEC 42001, você pode usar o artigo da DNV sobre “8 passos para a certificação do sistema de gestão ISO/IEC 42001” e a ferramenta de autoavaliação que o acompanha como orientação. O processo começa com uma revisão da alta direção para identificar os principais motivos para adotar um sistema de gestão de IA (AIMS). Após isso, as organizações devem obter o padrão ISO/IEC 42001 e definir uma direção estratégica que corresponda aos objetivos identificados.

As etapas seguintes incluem o planejamento e alocação de recursos, compreensão e mapeamento dos processos-chave e identificação das necessidades de treinamento para a equipe. Preparar, desenvolver e implementar processos e procedimentos aplicáveis são etapas típicas, e é importante realizar auditorias internas e revisões de gestão para verificar a eficácia do sistema ao longo do caminho. Usar a ferramenta de autoavaliação da DNV ajudará a identificar lacunas em relação aos requisitos do padrão e permitirá uma abordagem focada para atender às exigências da ISO/IEC 42001.

Por que escolher a DNV?

Como líder mundial em certificação, a DNV é o parceiro escolhido por 80.000 empresas em todo o mundo para suas necessidades de certificação de sistemas de gestão e treinamento. Temos competências únicas, conhecimento da indústria e capacidades relevantes para IA e outros sistemas de gestão. Ao escolher a DNV, você obtém:

- Player global em segurança da informação e garantia de privacidade: Temos um histórico robusto em certificação e treinamento em segurança da informação e privacidade, que são cruciais para integrar ao seu sistema de gestão de IA.

- Risk Based Certification™: Empregamos uma abordagem proativa baseada em riscos para a certificação, o que significa que podemos ajudar as organizações a identificar riscos potenciais em seus sistemas de IA desde cedo, garantindo que sejam abordados antes de se tornarem um problema.

- Lumina™: Esta é nossa ferramenta inteligente de benchmarking de dados que fornece insights mais profundos e análises sobre o sistema de gestão, desde as falhas e correções mais comuns até uma visão completa de todos os sites da empresa e comparações com os pares.

- Gestão de treinamentos: Soluções digitais para ajudar sua empresa a gerenciar e garantir a conscientização e o desenvolvimento de competências consistentes dos colaboradores em toda a organização.

- Auditores competentes que adotam uma abordagem pragmática, ouvindo as necessidades do cliente enquanto garantem que a conformidade com o padrão seja avaliada.

- Processos de gestão de clientes estruturados para oferecer uma experiência superior ao cliente.

A DNV está comprometida em fornecer serviços de garantia de IA confiáveis e de valor agregado. Com base em nossa independência, papel de terceira parte e princípio de não comprometer a qualidade e a integridade, fazemos parcerias com os clientes para ajudá-los a navegar nas complexidades da IA e nos desafios relacionados com confiança, garantindo a governança necessária para fornecer sistemas de IA que sejam seguros, confiáveis e protegidos.